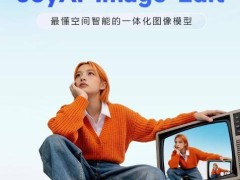

在AI圖像編輯領(lǐng)域,傳統(tǒng)模型長期面臨空間邏輯混亂的瓶頸——移動(dòng)物體時(shí)出現(xiàn)變形、切換視角時(shí)透視錯(cuò)亂、調(diào)整物體層級時(shí)遮擋關(guān)系失衡。這些難題源于模型對三維空間結(jié)構(gòu)的理解缺失,導(dǎo)致編輯操作僅停留在像素層面。京東探索研究院近日推出的開源模型JoyAI-Image-Edit,通過構(gòu)建完整的空間智能體系,實(shí)現(xiàn)了從平面修圖到三維空間重塑的技術(shù)跨越。

該模型創(chuàng)新性地將空間認(rèn)知能力深度融入圖像生成流程,通過建立相機(jī)坐標(biāo)系變換、物體空間位移旋轉(zhuǎn)、幾何結(jié)構(gòu)精準(zhǔn)控制等核心技術(shù)模塊,構(gòu)建起覆蓋空間位置關(guān)系、多視角一致性、場景推理等維度的完整體系。實(shí)驗(yàn)數(shù)據(jù)顯示,在物體移動(dòng)精度、空間布局合理性等關(guān)鍵指標(biāo)上,該模型已達(dá)到國際領(lǐng)先水平。其突破性在于打破了"生成圖像"與"理解空間"的界限,使AI既能生成逼真視覺效果,又能精準(zhǔn)維護(hù)場景的幾何規(guī)律與物理合理性。

三大核心編輯范式構(gòu)成技術(shù)護(hù)城河:視角變換功能支持通過自然語言指令調(diào)整相機(jī)參數(shù),在保持場景幾何一致性的前提下生成新視角圖像;空間漫游能力可連續(xù)生成邏輯連貫的多視角序列,實(shí)現(xiàn)三維場景中的"虛擬漫游";物體空間關(guān)系操控技術(shù)能在保持整體結(jié)構(gòu)穩(wěn)定的前提下,對特定物體進(jìn)行位移、縮放等操作,并自動(dòng)修正遮擋與光影關(guān)系。這些能力與15類通用編輯功能深度融合,覆蓋物體替換、風(fēng)格遷移、細(xì)節(jié)精修等高頻需求,形成全場景創(chuàng)作解決方案。

在具身智能等前沿領(lǐng)域,該模型展現(xiàn)出獨(dú)特價(jià)值。其空間理解能力為機(jī)器人感知環(huán)境提供了關(guān)鍵技術(shù)支撐,使機(jī)械臂操作、自主導(dǎo)航等任務(wù)獲得更精準(zhǔn)的空間坐標(biāo)參考。在電商內(nèi)容生產(chǎn)場景中,模型可自動(dòng)生成多角度商品展示圖;創(chuàng)意設(shè)計(jì)領(lǐng)域支持三維場景的快速構(gòu)建與修改;智能圖像處理方面能高效完成復(fù)雜場景的修復(fù)與重構(gòu)。技術(shù)團(tuán)隊(duì)透露,模型已實(shí)現(xiàn)推理代碼全開源,開發(fā)者可直接調(diào)用核心功能開發(fā)應(yīng)用。

這項(xiàng)突破是京東AI技術(shù)矩陣的重要拼圖。就在上月,該集團(tuán)剛開源了基礎(chǔ)大模型JoyAI-LLM Flash,通過架構(gòu)創(chuàng)新突破參數(shù)規(guī)模限制;京東云"龍蝦"系列產(chǎn)品上線后,token調(diào)用量周環(huán)比增長達(dá)455%;全球最大具身數(shù)據(jù)采集中心的建設(shè)也在穩(wěn)步推進(jìn)。依托實(shí)體產(chǎn)業(yè)場景優(yōu)勢,京東正持續(xù)推動(dòng)AI技術(shù)從實(shí)驗(yàn)室走向規(guī)模化應(yīng)用,構(gòu)建起覆蓋基礎(chǔ)研究、技術(shù)開發(fā)、產(chǎn)業(yè)落地的完整生態(tài)。