蘋果公司在強化學習領(lǐng)域邁出了創(chuàng)新步伐,其研究人員最近提出了一種名為“基于清單反饋的強化學習”(RLCF)的新方法。這一方法旨在優(yōu)化大語言模型(LLMs)處理復(fù)雜指令的能力,摒棄了傳統(tǒng)的人類點贊或點踩評分模式。

RLCF,全稱Reinforcement Learning from Checklist Feedback,它的核心在于為每個用戶指令生成詳細的檢查清單,并根據(jù)0到100分的評分系統(tǒng)對每一項進行評判。這一改變,使得模型在優(yōu)化過程中能夠接收到更加具體和針對性的反饋,而非僅僅依賴于籠統(tǒng)的人類喜好。

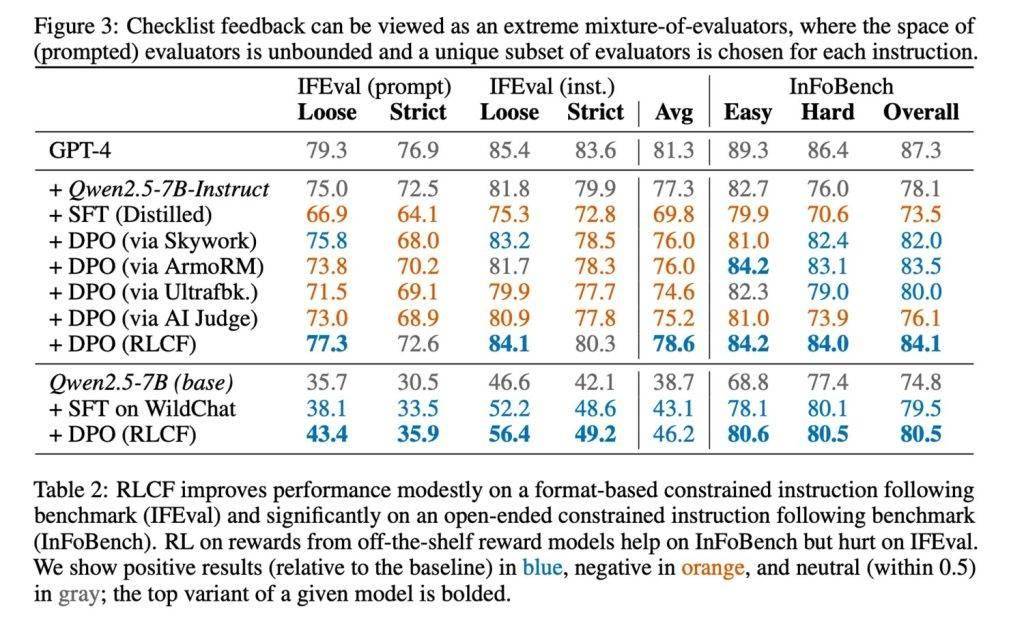

為了驗證RLCF方法的有效性,研究團隊在強指令跟隨模型Qwen2.5-7B-Instruct上進行了測試,測試涵蓋了五個常用的評測基準。結(jié)果顯示,RLCF在所有測試中均取得了顯著提升:FollowBench的硬性滿意率提高了4個百分點,InFoBench提升了6點,Arena-Hard的勝率增加了3點,部分任務(wù)的最大提升甚至達到了8.2%。這些數(shù)據(jù)無疑證明了清單反饋在應(yīng)對復(fù)雜、多步驟任務(wù)時的強大效果。

在清單的生成方面,蘋果的研究團隊也展現(xiàn)出了獨到的見解。他們利用規(guī)模更大的Qwen2.5-72B-Instruct模型,結(jié)合現(xiàn)有的研究方法,為13萬條指令創(chuàng)建了名為“WildChecklists”的數(shù)據(jù)集。這些數(shù)據(jù)集中的清單條目都是明確的二元判斷項,例如“是否準確翻譯為目標語言”。隨后,大模型會對候選回答進行逐項評分,并將這些評分綜合加權(quán),作為小模型訓練的獎勵信號。

然而,蘋果研究者也坦誠地指出了RLCF方法的局限性。首先,它依賴于性能更強的模型作為評判者,這在資源受限的環(huán)境下可能難以實現(xiàn)。其次,RLCF專注于提升復(fù)雜指令的執(zhí)行能力,并未專門設(shè)計用于安全性對齊,因此不能替代安全性評估與優(yōu)化。對于其他類型的任務(wù),該方法的適用性仍需進一步的研究和驗證。